“超智能的实现已近在咫尺,”马克·扎克伯格如此断言,预示着“人类将创造出如今难以想象的全新事物”。达里奥·阿莫迪则预测,强大的人工智能“最早可能在2026年问世,在多数关键领域,其智慧将超越诺贝尔奖得主”;他甚至进一步畅想,这或将使人类寿命翻倍,乃至实现“摆脱死亡”的终极愿景。“我们如今已确信,掌握了构建通用人工智能(AGI)的方法,”萨姆·阿尔特曼表示——这正是人工智能领域梦寐以求的圣杯;而就在不远的将来,超智能AI“将极大地加速科学发现与创新,其突破将远超人类自身能力的极限”。

“超智能的实现已近在咫尺,”马克·扎克伯格如此断言,预示着“人类将创造出如今难以想象的全新事物”。达里奥·阿莫迪则预测,强大的人工智能“最早可能在2026年问世,在多数关键领域,其智慧将超越诺贝尔奖得主”;他甚至进一步畅想,这或将使人类寿命翻倍,乃至实现“摆脱死亡”的终极愿景。“我们如今已确信,掌握了构建通用人工智能(AGI)的方法,”萨姆·阿尔特曼表示——这正是人工智能领域梦寐以求的圣杯;而就在不远的将来,超智能AI“将极大地加速科学发现与创新,其突破将远超人类自身能力的极限”。

我们该相信它们吗?倘若我们秉持人类智能的科学认知,仅从这些公司迄今推出的人工智能系统来看,答案显然是否定的。

OpenAI的ChatGPT、Anthropic的Claude、Google的Gemini,以及Meta近日所宣称的AI产品,这些聊天机器人虽形态各异,却共享一个根本属性:它们本质上都是“大型语言模型”。其运作原理在于,依托互联网上海量的语言数据(其中绝大多数以文本形式编码),捕捉词语之间的关联——更精确地说,是识别被称为“标记”(tokens)的子词单元——并根据用户输入的提示(prompt),预测最可能的输出结果。尽管生成式AI被赋予了复杂性的光环,但其核心仍不过是一套精巧的语言建模机制。

问题在于,根据当前的神经科学研究,人类的思维在很大程度上独立于语言——我们并无充分理由相信,对语言进行愈发复杂的建模,便能催生出达到甚至超越人类水平的智能。语言是人类用于交流推理、构建抽象概念与实现概括的工具,正是这些能力构成了我们所称的“智能”成果。我们借助语言进行思考,但这并不意味着语言本身等同于思维。真正理解这一本质差异,正是区分科学真相与AI领域狂热创业者所渲染的科幻幻想的关键所在。

人工智能的炒作机器持续鼓吹一种观念:我们正站在创造超越人类智慧、甚至实现“超智能”时代的边缘。只要汇聚海量世界数据,再借助日益强大的计算能力——简而言之,就是依赖Nvidia芯片的算力——只需不断扩展规模,通用人工智能(AGI)便唾手可得。规模即答案,一切尽在其中。

然而,这一信念在科学上存在根本性漏洞。大型语言模型(LLM)不过是一种模拟语言交流功能的工具,远非独立于语言之外的思考与推理机制。无论我们建造多少数据中心,堆砌多少算力,都无法弥补这一本质的缺失。

我们固然用语言来思考,但这绝不意味着语言本身即是思维。 去年,三位科学家在《自然》杂志上发表了一篇评论,题为《语言主要是交流的工具,而非思维的工具》,以令人钦佩的清晰与洞见,深刻阐明了这一核心观点。该文由麻省理工学院(MIT)的Evelina Fedorenko、加州大学伯克利分校(UC Berkeley)的Steven T. Piantadosi,以及麻省理工学院(MIT)的Edward A.F. Gibson共同撰写,是对语言与思维关系长达数十年科学研究的全面总结。文章旨在达成两个目标:其一,破除“语言催生思维与推理能力”的流行观念;其二,确立语言作为人类共享思想的文化媒介这一根本定位。

接下来,我们逐一探讨这些论点。

当我们回溯自身的思维过程时,常会误以为自己是“用某种特定语言”在思考,因而将思维归因于语言。然而,倘若语言果真是思维不可或缺的基石,那么一旦剥夺语言,思维能力理应随之消失。但事实恰恰相反。我必须再次强调:语言的缺失,并不意味着思维的终结。这一结论并非空穴来风,而是有坚实的实证支持。

首先,借助先进的功能性磁共振成像(fMRI)技术,我们得以窥见人类在执行各类心理任务时,大脑不同区域的动态激活模式。研究发现,当我们进行解数学题、推测他人心理状态等认知活动时,大脑中被激活的神经网络,其分布与语言处理区域明显分离,构成一组独立而自主的神经回路。

Nature 其次,针对因脑损伤或其他疾病而丧失语言能力的人类所开展的研究明确表明,语言能力的缺失并不会从根本上削弱其整体思维能力。费多伦科(Fedorenko)等人指出:“证据确凿无疑:存在大量语言功能严重受损的个体,他们依然保有完整的认知能力。” 这些人能够解决数学问题,理解非语言指令,洞察他人动机,并开展各类推理——包括形式逻辑推理以及对世界因果关系的深刻理解。

如果你想亲自探寻这个问题,不妨尝试一种简单而深刻的方法:找一个婴儿,静静观察他们(当他们醒着的时候)。你一定会看到一个小小的生命正充满好奇地探索周遭的世界——摆弄物品,发出声音,模仿面部表情,在一次次互动与体验中悄然学习。认知科学家艾莉森·戈普尼克指出:“研究表明,儿童理解世界的方式与科学家惊人地相似——他们通过实验、分析统计信息,并逐步建立起关于物理、生物与心理领域的直觉性理论。” 而这一切,都发生在他们学会说话之前。尽管婴儿尚不能言说,但显然,他们早已在思考。每一位父母都曾深深体味过见证孩子认知能力逐步萌发的欣喜,至少在他们进入青春期之前,这份喜悦始终如一。

因此,从科学视角来看,语言仅是人类思维的一个维度,我们智力的绝大部分实际上依赖于非语言的能力。那么,为何大多数人却直觉上难以接受这一点?

这引出了Fedorenko等人在《Nature》文章中的第二个核心观点:语言本质上是我们用以交流思想的工具——正如他们所言,是一种“高效的通信编码”。这一论断在人类语言的广泛多样性中得到了印证:尽管各语言千差万别,却共享若干共同特征——易于生成、易于习得与理解、表达简洁高效,且对噪声具有强鲁棒性。

甚至在人工智能领域内部,对大型语言模型(LLM)的质疑之声也已悄然兴起。 无需深究语言学的繁复细节,关键在于:作为物种的人类,正是通过语言这一媒介,得以高效传递当下经验,并跨越世代传承知识,从而获得了无与伦比的优势。正如认知科学家塞西莉亚·黑斯(Cecilia Heyes)所言,语言是一种“认知工具”,它“使人类能够以非凡的效率、保真度与精确性,从他人那里学习”。

语言确乎拓展了我们的认知边界,但它本身并非认知的源头,亦非其定义所在。

即便我们丧失了言语能力,依然可以思考、推理、建立信念、感受爱意,并在世界中行动;我们的体验与思维之广度,依然深邃而丰富。

然而,若从大型语言模型中剥离语言,你将一无所获。

一位人工智能爱好者或许会辩称,人类水平的智能未必需要以与人类认知完全相同的方式实现。事实上,人工智能模型在国际象棋等特定领域已超越人类表现,其运作机制与我们的思维过程大相径庭。因此,或许它们能够通过某种独特的方式——基于从海量训练数据中提取的关联模式——实现超智能。

然而,这仅是可能而已。并无确凿理由表明,仅靠文本数据的训练就能催生真正的通用智能,而非仅在特定任务上表现出色。毕竟,人类所掌握的知识远超语言所能承载的范畴——倘若你对此心存疑问,不妨回想一下:你是如何学会骑自行车的?那种身体记忆与直觉,又岂是语言所能完整描述?

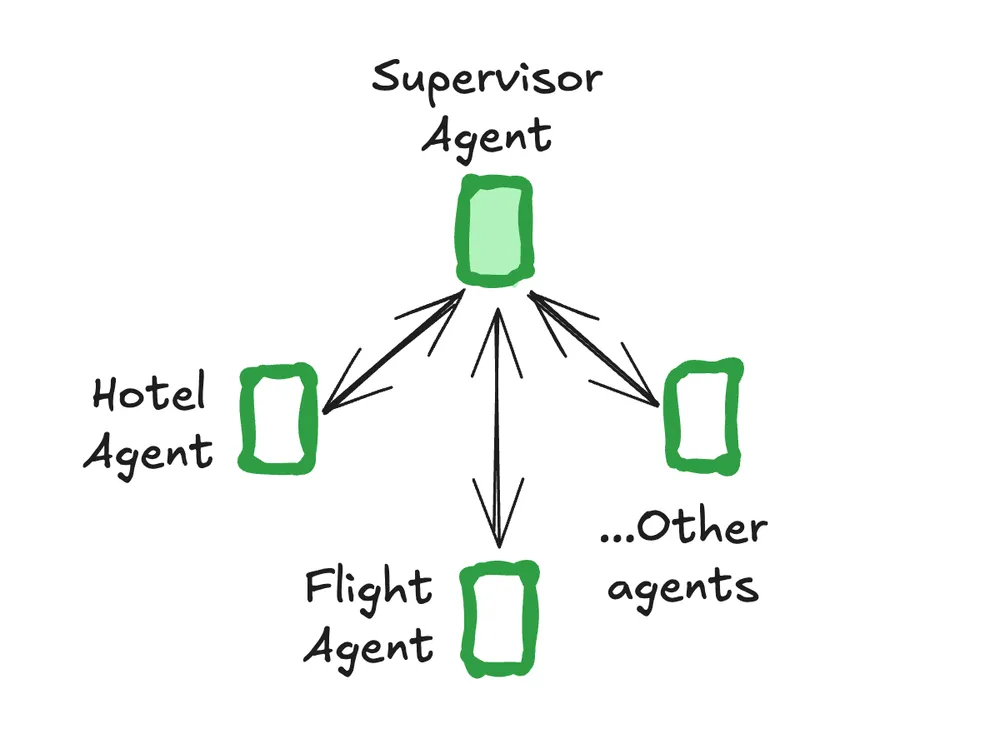

事实上,人工智能研究界正有越来越多的声音指出,大型语言模型(LLM)本身难以成为人类智能的恰当模型。例如,图灵奖得主、人工智能领域权威杨立昆(Yann LeCun)——同时也是大型语言模型的著名批判者——上周已从Meta离职,创立了一家AI初创企业,专注研发所谓的“世界模型”:一种能够理解物理世界、具备持久记忆、并能进行复杂推理与行动规划的系统。

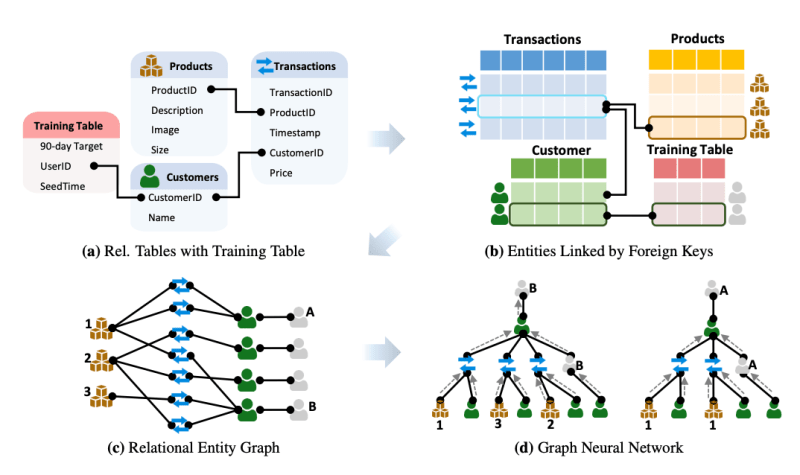

近期,一群知名人工智能科学家与思想领袖——包括另一位图灵奖得主约书亚·本吉奥(Yoshua Bengio)、前谷歌CEO埃里克·施密特(Eric Schmidt),以及长期质疑当前AI发展路径的加里·马库斯(Gary Marcus)——联合发布了一份关于通用人工智能(AGI)的工作定义:即“在认知的多功能性与熟练程度上,达到或超越受过良好教育的成年人水平”。该定义特别强调“多功能性”这一核心要素。他们不再将智能视为单一维度的能力,而是主张构建一种反映“由多种异质能力交织而成的复杂认知架构”的人类与人工智能认知模型。 他们认为,智能大致呈现出以下形态:

人工智能安全中心 这究竟是进步吗?或许可以这么说——至少,它让我们摆脱了盲目追逐更多训练数据以填满服务器机架的荒谬循环。然而,核心问题依然悬而未决:我们真能通过简单叠加个体认知能力,将它们的总和视为通用智能吗?又该如何衡量这些能力的权重?哪些应被纳入,哪些又该被排除?我们口中的“知识”或“速度”,究竟所指为何,又在何种语境下成立?尽管这些专家一致认为,单纯扩大语言模型的规模绝无可能达成目标,但他们所提出的前进方向却众说纷纭——与其说是一张通往未来的路线图,不如说只是描绘了一个更清晰的目标。

无论采用何种技术路径,假定在不久的将来,我们成功构建出一个在本蜘蛛网图所涵盖的广泛认知挑战任务中表现卓越的AI系统,我们是否就真正实现了科技巨头CEO们所承诺的那种能催生颠覆性科学发现的智能?答案未必。因为仍存在一个根本性的障碍:即便AI完美复现了人类现有的思维方式,也并不能确保它能够实现人类历史上那些突破性的认知跃迁。

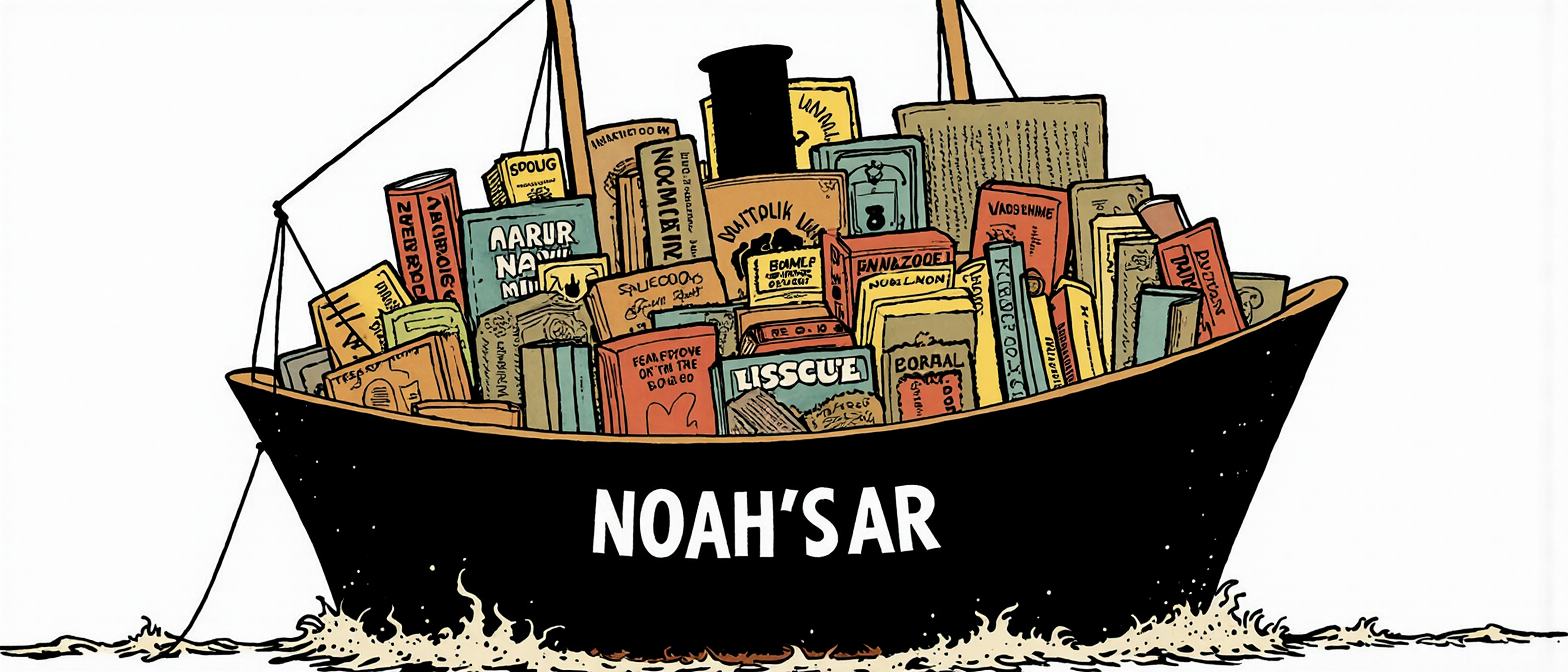

“科学范式”这一概念源自托马斯·库恩的著作《科学革命的结构》。这些范式构成了我们在特定历史时期理解世界的基本框架。库恩指出,范式的转变并非源于渐进的实验迭代,而是当新的问题与思想涌现,超出现有科学叙事的容纳能力时,才会发生根本性跃迁。以爱因斯坦为例,他在实证支持尚未出现之前,便已提出相对论,正是这种突破性思维的体现。基于此,哲学家理查德·罗蒂进一步指出,当科学家与艺术家对既有范式(或他所称的“词汇”)感到不满时,便会创造出全新的隐喻,进而催生对世界认知的全新图景;若这些新思想具备实践价值,便逐渐融入我们对“真实”的集体理解。因此,罗蒂认为:“常识,不过是一系列已逝的隐喻。”

根据当前的设计构想,这一涵盖多认知领域的AI系统,能够预测并模拟普遍智能的人类在面对特定提示时的反应与表达方式。其预测建立在对海量已有数据的数字化聚合与建模基础之上,甚至可看似自然地将新范式融入自身模型。然而,这类系统并无内在动力对所接收的信息产生质疑——因而也难以激发真正的科学突破或创造性跃迁。

相反,其最显著的成果不过是一套精巧的常识库罢了。诚然,人工智能系统或许能以令人惊叹的方式重组与复用我们的知识,但仅止于此。它将永远困于我们编码进数据、并用于训练它的词汇框架之中——一台精密却死板的隐喻机器。而真正的人类——那些能够思考、推理,并通过语言传递思想的存在——仍将始终站在推动人类对世界认知变革的最前沿。

来源:https://www.theverge.com/ai-artificial-intelligence/827820/large-language-models-ai-intelligence-neuroscience-problems

评论 (0)

还没有评论,来说两句吧!